MaxClaw

MiniMax Agent 是基于顶尖多模态大语言模型打造的智能AI伙伴,为你带来全方位的智能体验。

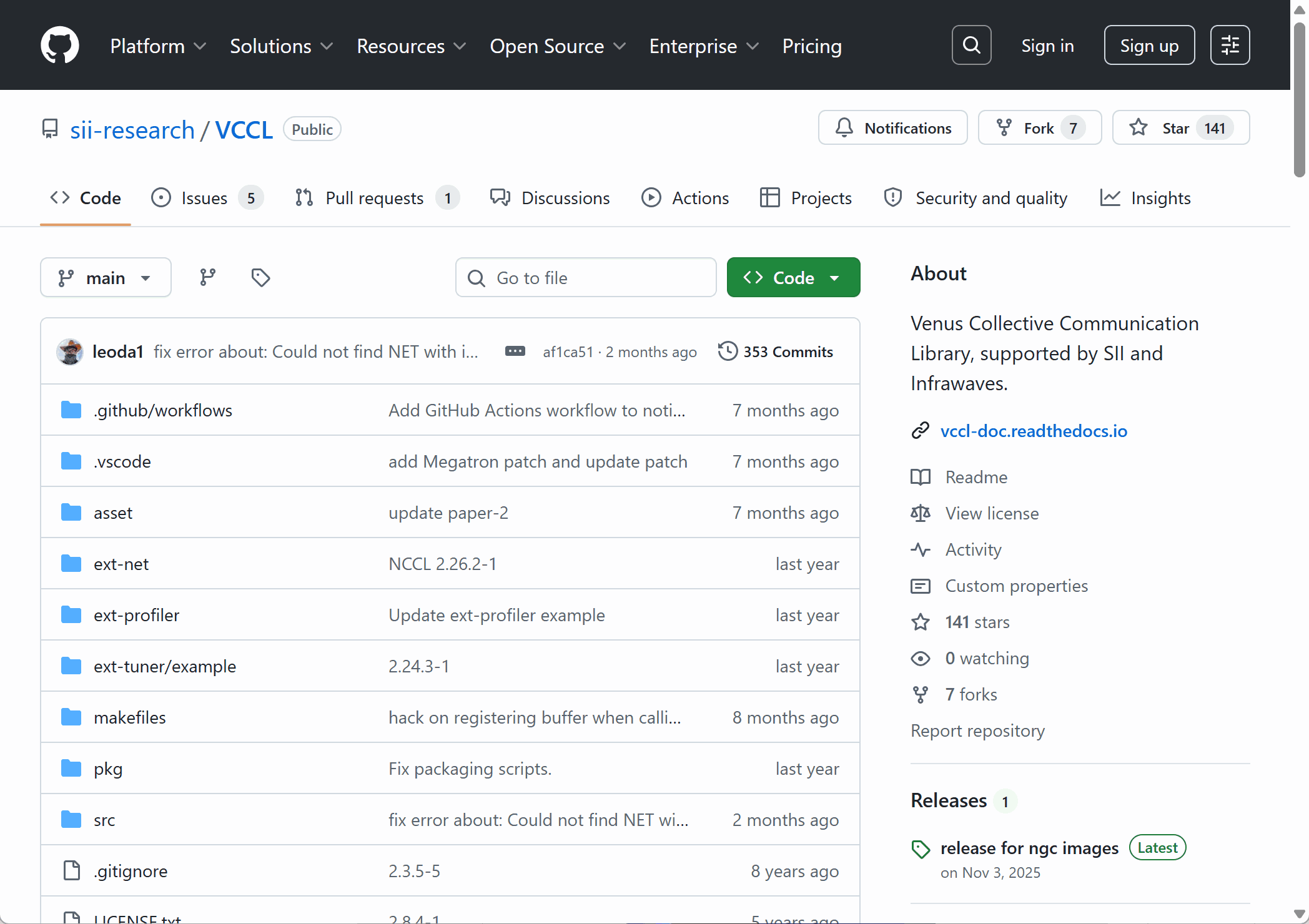

VCCL,全称 Video Cross-modal Contrastive Learning,是一种面向视频和多模态数据的对比学习框架。它的核心目标是通过对视频内容的多维度表征,提升模型对视频语义的理解能力。与传统方法不同,VCCL 不仅关注视频的视觉特征,还充分利用了文本、音频等跨模态信息,通过对比学习机制,使模型能够在海量视频中实现高效的语义匹配与检索。

简单来说,VCCL 就像是一个“视频语言翻译官”,它能够让计算机理解视频内容的核心含义,并将其与文本描述建立高精度关联。这对于视频搜索、智能剪辑、内容推荐等应用场景都具有重要价值。

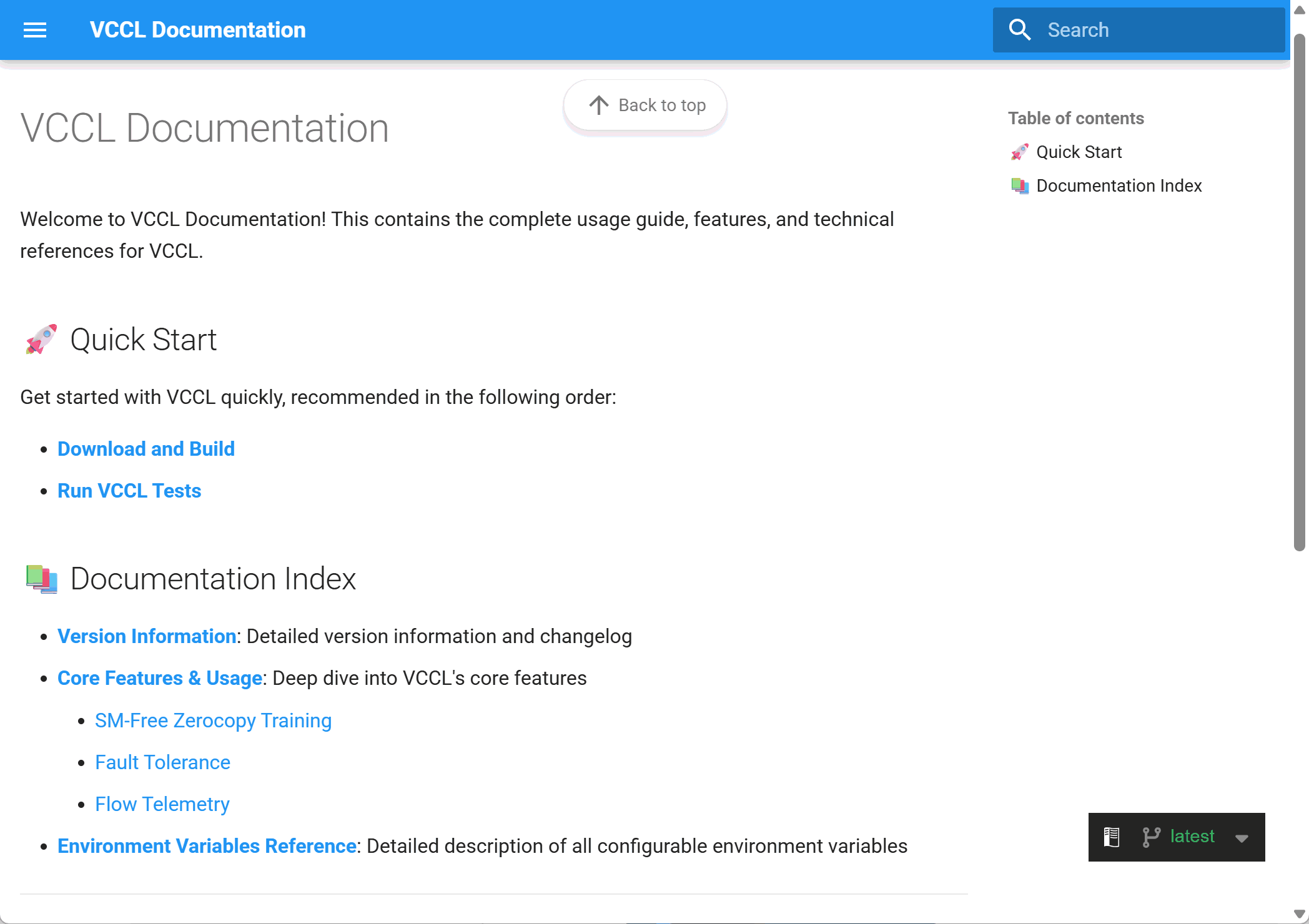

VCCL 网页图片

VCCL 的应用场景非常广泛:

随着短视频、直播、元宇宙等产业的发展,对视频理解的需求只会越来越高。VCCL 的出现,为解决这些复杂场景下的视频语义理解问题提供了强有力的工具。

VCCL 是一个兼具创新性与实用性的开源项目,它将对比学习、跨模态建模和高效视频表征有机结合,为 AI 视频理解提供了全新思路。